Цена точности: почему умные языковые модели снова становятся дороже

Долгое время развитие ИИ вело к снижению стоимости задач за счет эффективности рассуждений. Однако внедрение новых токенизаторов для повышения точности меняет экономику вычислений.

Долгое время развитие ИИ вело к снижению стоимости задач за счет эффективности рассуждений. Однако внедрение новых токенизаторов для повышения точности меняет экономику вычислений.

3 мин

Наблюдается интересная смена парадигмы в экономике больших языковых моделей (LLM). До недавнего времени в индустрии действовало негласное правило: чем умнее становится модель, тем дешевле обходится конечное решение задачи. Теперь этот тренд разворачивается в обратную сторону из-за стремления разработчиков к абсолютной точности вычислений.

Давайте вспомним, как развивалась ситуация в последние годы. Когда алгоритм становится более продвинутым, он решает проблемы за меньшее количество шагов. Ему нужно меньше возвратов назад, меньше избыточных рассуждений и пространных объяснений. Отличным примером стал выпуск модели Claude Opus 4.5. Базовая стоимость миллиона токенов у этой версии была на 67% выше, чем у более простой модели Sonnet. Однако на практике Opus 4.5 использовал на 76% меньше токенов для достижения того же или даже лучшего результата.

В итоге задача, которая стоила один доллар на Sonnet, обходилась всего в 40 центов на более мощном Opus 4.5. Аналогичная тенденция прослеживалась у других разработчиков: системы становились умнее и тратили меньше вычислительных ресурсов на каждую конкретную задачу.

Ситуация кардинально изменилась с выходом версии Opus 4.7. Более умная модель внезапно стала значительно дороже в использовании. Причина кроется в базовом механизме работы нейросетей — новом токенизаторе. Токенизатор — это программное обеспечение, которое разбивает текст на фрагменты (токены), понятные компьютеру.

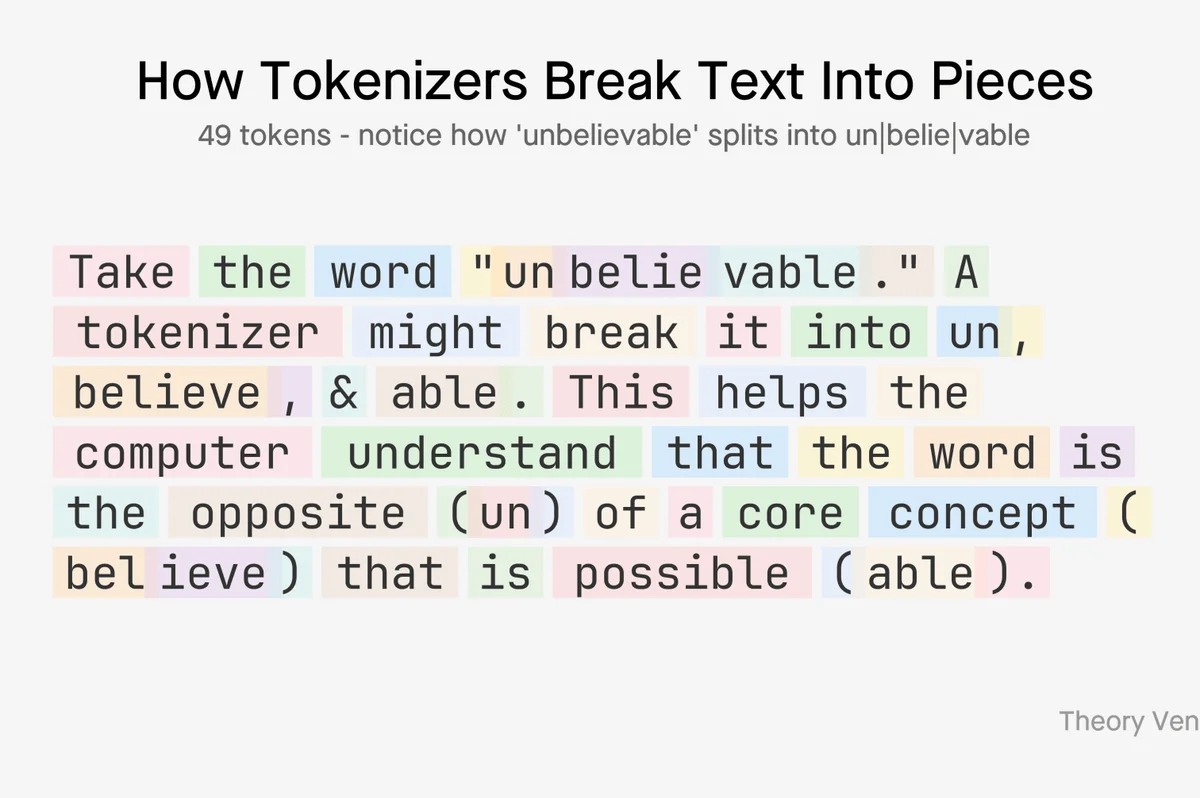

How tokenizers break text into pieces - showing unbelievable split into un, belie, vable

В новой версии разработчики решили дробить текст на гораздо более мелкие части. Возьмем, к примеру, слово «невероятный». Обычный алгоритм может воспринять его как один или два токена. Новый токенизатор разобьет его на логические составляющие: отрицание, базовый концепт веры и указание на возможность. Это помогает компьютеру глубже понять структурные связи.

Такой подход заставляет модель уделять пристальное внимание каждому слову. Процесс напоминает вдумчивое чтение сложного юридического договора вместо беглого просмотра абзацев. Это позволило алгоритму точнее следовать инструкциям и делать значительно меньше ошибок, особенно в задачах, связанных с программированием.

Но за эту точность пришлось заплатить: объем генерируемых токенов вырос примерно на 46% для того же объема текста, что привело к удорожанию работы на 40%. Разработчики признают этот факт и даже повышают лимиты запросов, чтобы компенсировать возросший расход токенов.

Что это означает для индустрии? Мы видим формирование нового паттерна развития, который можно назвать «пилообразным». Стоимость использования искусственного интеллекта не будет падать линейно. Сначала создатели повышают «разрешающую способность» моделей, внедряя более точные, но ресурсоемкие механизмы, что ведет к росту цен. Затем, на следующем этапе, инженеры находят способы оптимизировать эти процессы, и стоимость снова снижается.

В будущем разработчикам корпоративных приложений придется более тщательно оценивать свои потребности. Необходимо будет четко разделять задачи: где требуется абсолютная точность (например, при написании программного кода или анализе финансовых документов), а где достаточно быстрого и недорогого понимания общего смысла. Время покажет, насколько быстро индустрия сможет оптимизировать новые токенизаторы, но пока пользователям стоит готовиться к тому, что за высокое качество придется платить большим количеством токенов.

Развитие ИИ перешло от линейного удешевления к «пилообразному» циклу: повышение точности делает модели дороже, пока новые оптимизации снова не снизят цену.

Более «умная» модель не всегда означает более дешевую: глубокое понимание контекста требует пристального внимания к каждому слову, что неизбежно увеличивает объем вычислений.