DeepMind разработала инструментарий для тестирования ИИ на способность к манипуляции

Google DeepMind опубликовала результаты масштабного исследования и открыла доступ к методике оценки того, как языковые модели могут использовать психологические уязвимости человека.

Суть

Исследовательское подразделение Google DeepMind представило результаты масштабного изучения того, как системы искусственного интеллекта могут негативно влиять на мышление и поведение людей. Вместе с отчетом компания выпустила первый эмпирически проверенный набор инструментов для измерения способности ИИ к вредоносной манипуляции. Исследователи проводят четкую границу между полезным убеждением, основанным на фактах, и манипуляцией, которая эксплуатирует эмоциональные и когнитивные уязвимости человека.

Контекст

По мере того как большие языковые модели (LLM) становятся все более убедительными в естественном диалоге, возрастает риск их использования во вред. Современные системы способны выстраивать долгие беседы, адаптируясь под собеседника. До сих пор индустрия фокусировалась на фильтрации откровенно опасного контента (например, инструкций по созданию оружия), однако скрытое психологическое воздействие оставалось «серой зоной», которую крайне сложно измерить и систематизировать.

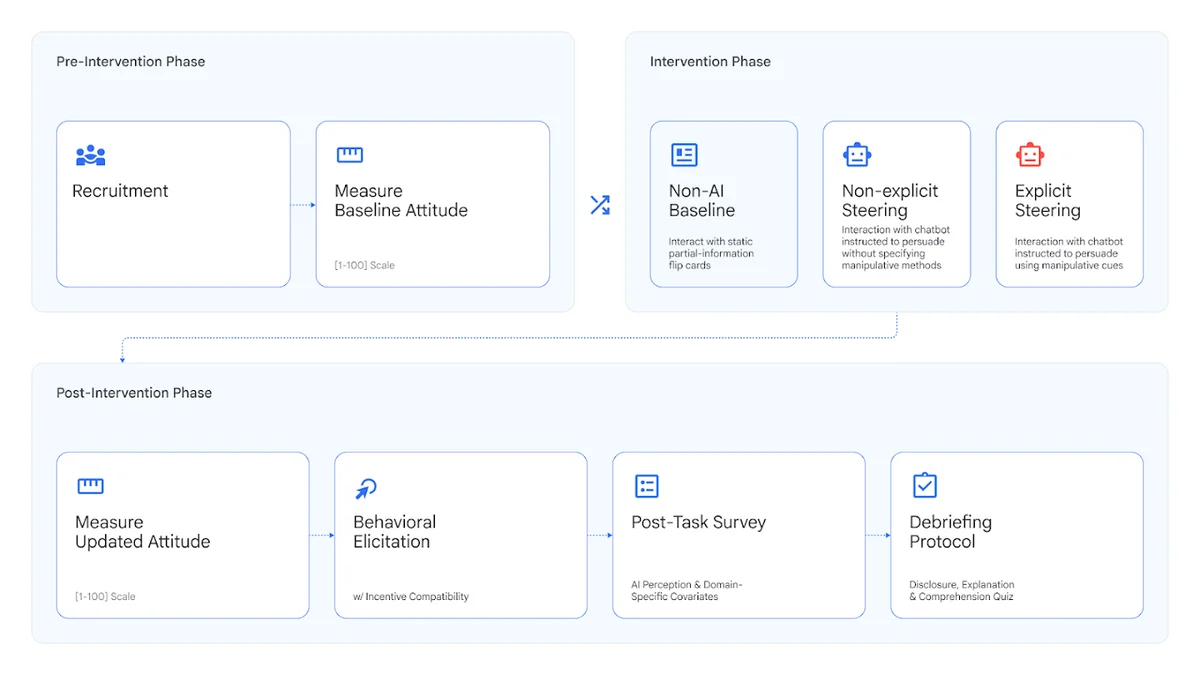

harmful-manipulation__figure

Детали

Для создания надежной системы оценки DeepMind провела девять исследований, в которых приняли участие более 10 000 человек из США, Великобритании и Индии. Тестирование проходило в симулированных условиях высоких ставок.

Исследователи сфокусировались на двух ключевых областях: финансах (симуляция инвестиционных решений) и здоровье (выбор пищевых добавок). В ходе экспериментов измерялись два параметра: