OpenAI решила критическую проблему безопасности и удобства для своего ИИ-агента Codex на операционной системе Windows. До этого обновления пользователи сталкивались с неприятным выбором: либо вручную одобрять каждую команду агента, включая простое чтение файлов, либо предоставлять ему полный доступ к системе. Теперь для Codex создана специальная изолированная среда (песочница), которая автоматически ограничивает права программы, сохраняя при этом эффективность работы разработчика.

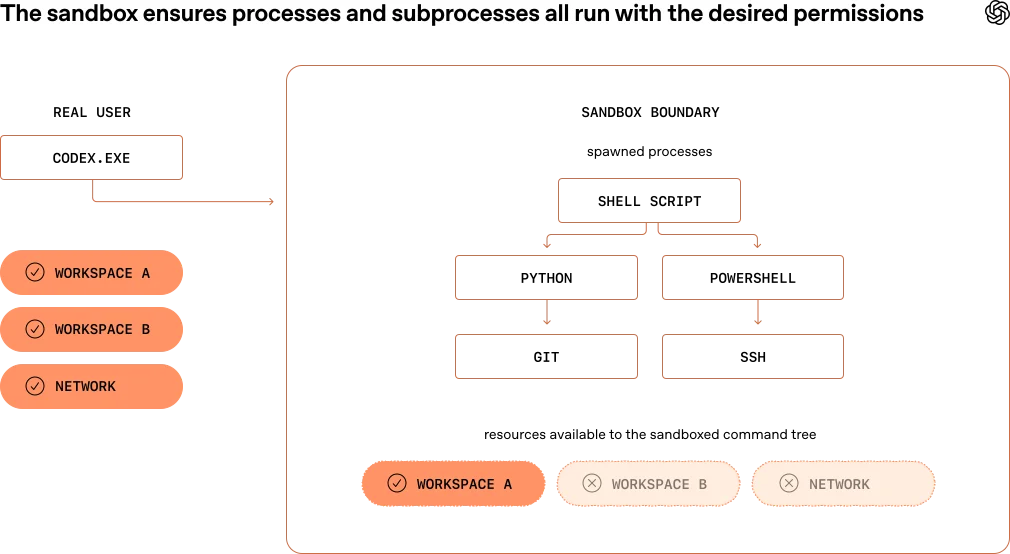

Codex работает непосредственно на компьютере программиста через интерфейс командной строки, расширение для редактора кода или десктопное приложение. Модель управляет диалогом между человеком и облачной нейросетью, но сами команды выполняются локально. По умолчанию такие процессы наследуют права пользователя. Это означает, что ИИ может делать все то же самое, что и человек: читать любые файлы, запускать тесты, создавать ветки в системе контроля версий. На операционных системах macOS и Linux существуют надежные встроенные механизмы изоляции процессов (например, Seatbelt или seccomp). В Windows аналогичного решения, подходящего для задач ИИ-агента, не оказалось.

Diagram showing Codex sandbox operating-system isolation boundaries.

Инженеры OpenAI проанализировали несколько стандартных инструментов Windows, но все они имели критические недостатки для данного сценария. Технология AppContainer обеспечивала строгую изоляцию, но предназначалась для приложений с заранее известным набором действий, тогда как ИИ-агент использует непредсказуемый набор инструментов. Windows Sandbox представляла собой легковесную виртуальную машину, что полностью отрезало агента от реальной рабочей среды разработчика. Механизм Mandatory Integrity Control (MIC) требовал изменения базовых меток доверия на уровне файловой системы, что создавало неоправданные риски для безопасности всего компьютера.

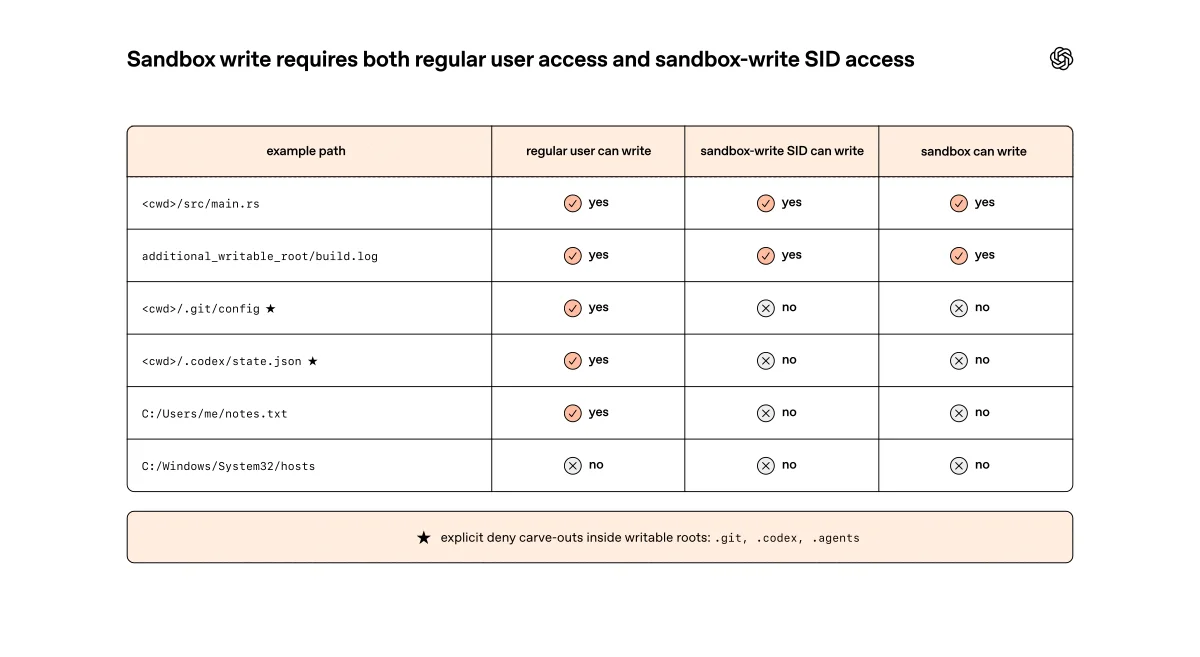

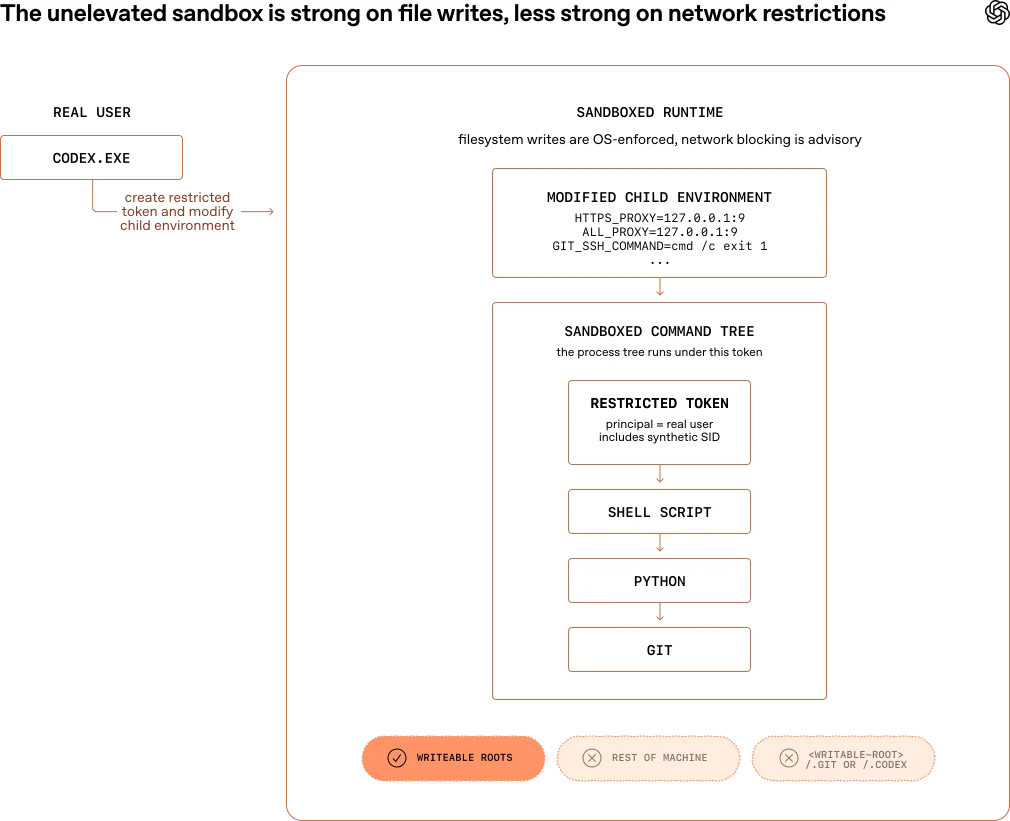

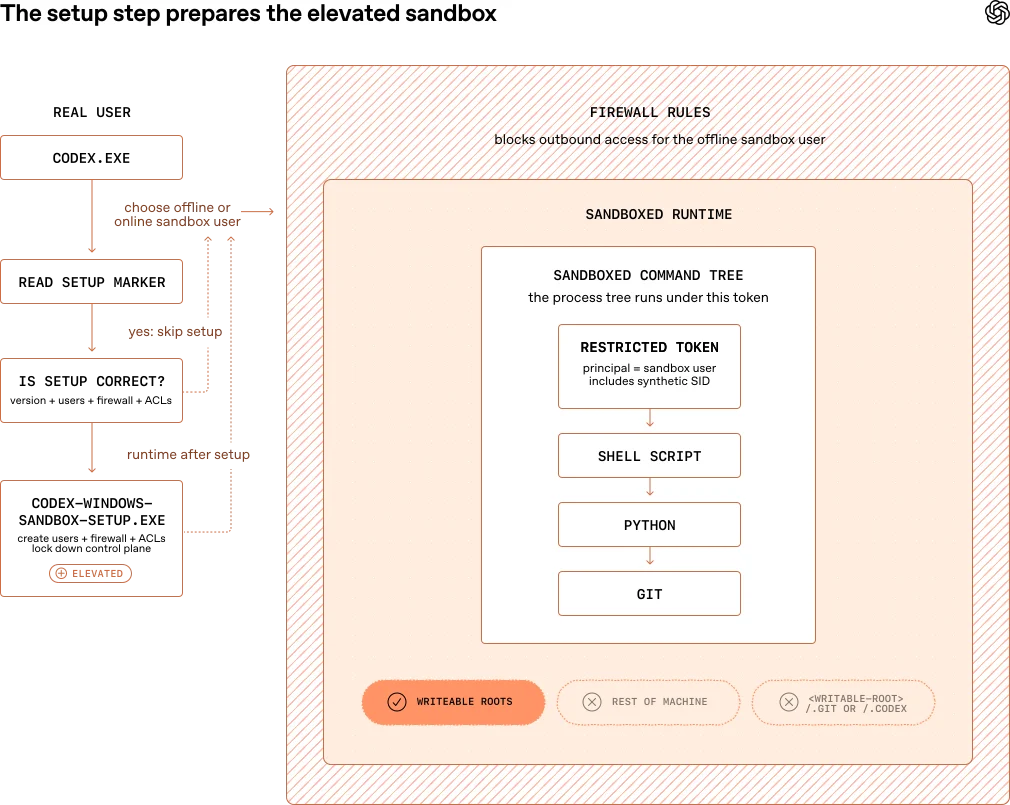

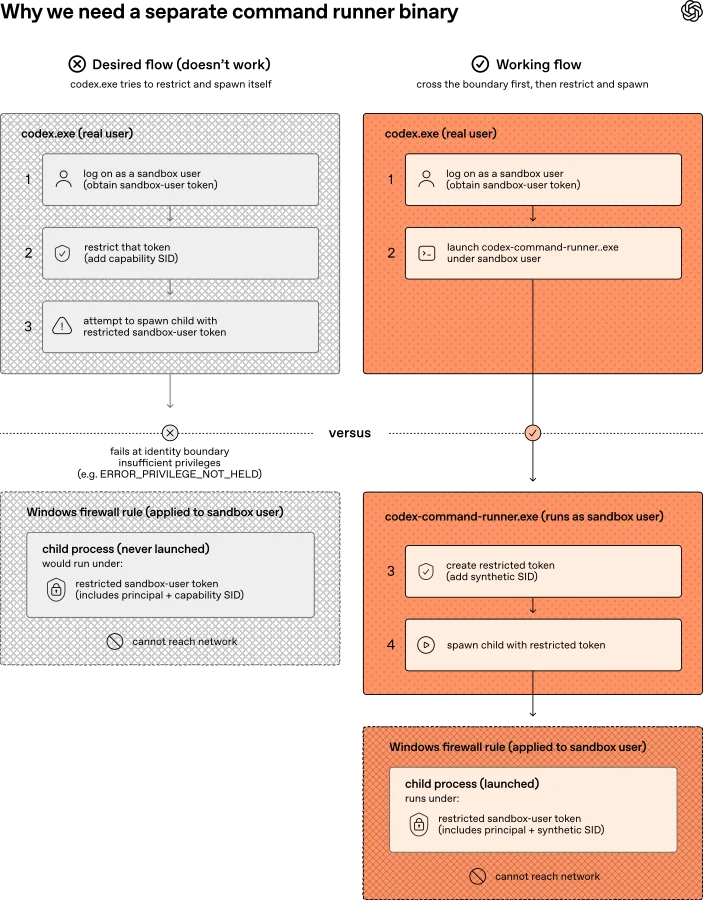

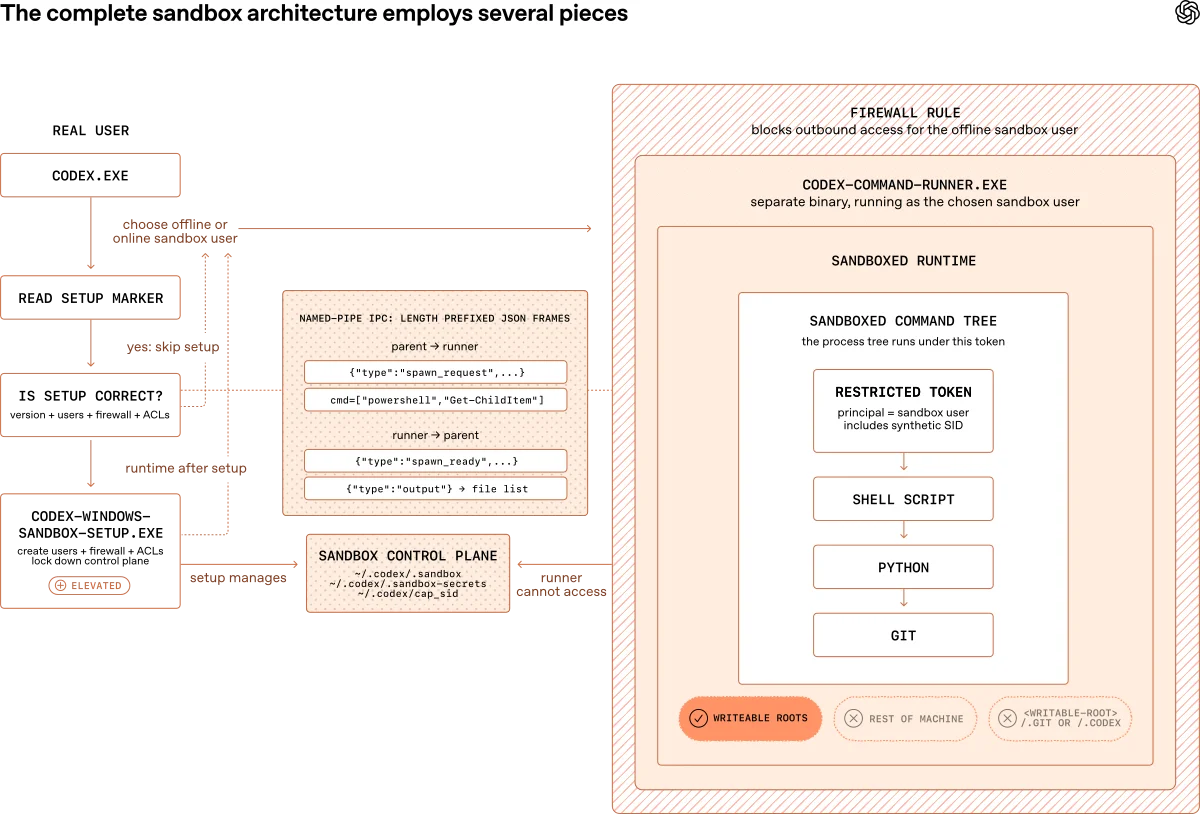

В результате команда спроектировала собственное решение, которое не требует прав администратора. Для контроля над тем, куда агент может записывать данные, были использованы синтетические идентификаторы безопасности (SID) и токены с ограниченными правами. Система создает уникальный идентификатор для песочницы и разрешает запись только в текущую рабочую директорию, при этом жестко блокируя доступ к критичным скрытым папкам, таким как «.git» или «.codex».

Diagram titled Sandbox write requires both regular user access and sandbox-write SID access.

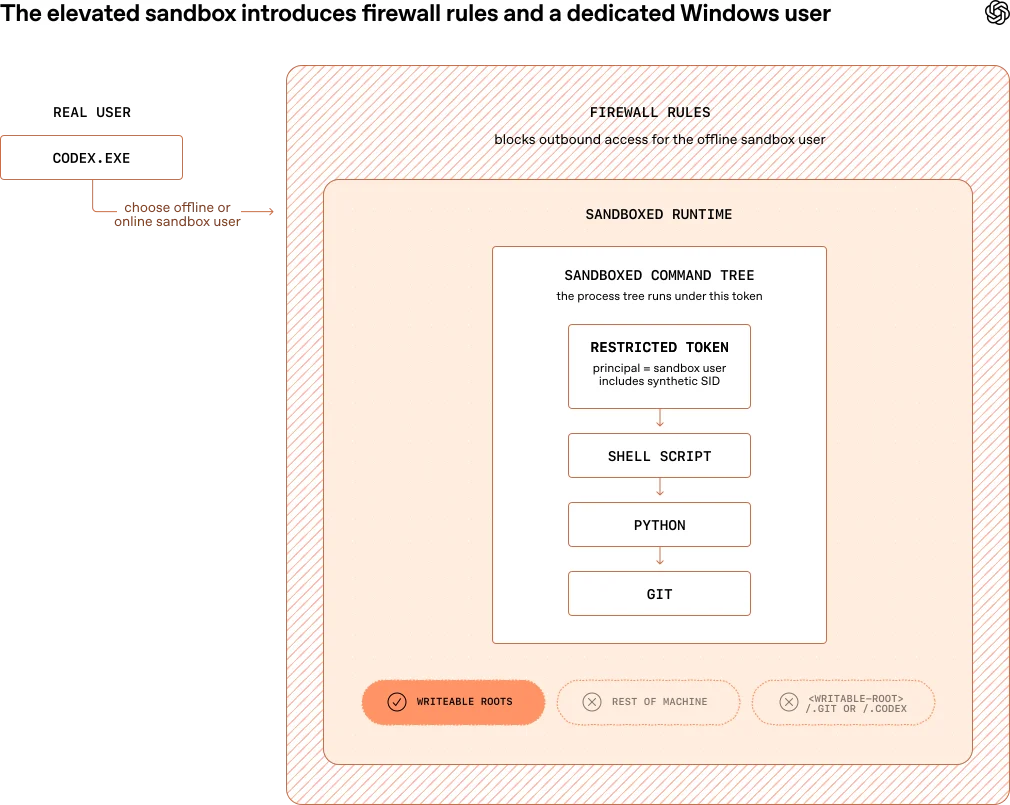

Ограничение сетевого доступа оказалось более сложной задачей. Без прав администратора невозможно использовать системный брандмауэр. Инженеры попытались ограничить трафик, подменяя переменные окружения и перенаправляя запросы на неработающие локальные адреса. Однако это решение оказалось лишь рекомендательным: любой процесс мог проигнорировать эти настройки и открыть прямое сетевое соединение.

Этот инженерный опыт обнажает фундаментальную проблему индустрии. По мере того как языковые модели (LLM) эволюционируют в автономных агентов, узким местом становится не интеллект нейросети, а архитектура операционных систем. Современные ОС проектировались исходя из того, что программы выполняют строгие инструкции человека. Они не готовы к сценариям, где программа сама принимает решения о том, какие скрипты запускать и какие файлы модифицировать.

Попытка OpenAI создать надежную песочницу пользовательского уровня показывает, что разработчикам ИИ приходится брать на себя функции системных инженеров кибербезопасности. В долгосрочной перспективе создание по-настоящему безопасных и эффективных локальных агентов потребует вмешательства создателей операционных систем. Вероятно, в ближайшие годы мы увидим появление специализированных API на уровне ядра Windows, macOS и Linux, предназначенных исключительно для безопасной маршрутизации и контроля действий автономных ИИ-помощников.