Защита данных в эпоху агентов: OpenAI вводит режим изоляции и маркировку рисков

OpenAI представляет Lockdown Mode для защиты от промпт-инъекций и утечки данных, а также вводит маркировку функций с повышенным риском для корпоративных пользователей.

OpenAI представляет Lockdown Mode для защиты от промпт-инъекций и утечки данных, а также вводит маркировку функций с повышенным риском для корпоративных пользователей.

4 мин

OpenAI объявила о внедрении двух важных механизмов защиты в экосистему ChatGPT: режима изоляции (Lockdown Mode) и маркировки функций повышенного риска (Elevated Risk labels). Это обновление, датированное февралем 2026 года, направлено на решение одной из самых сложных проблем в безопасности больших языковых моделей — защиты от промпт-инъекций (prompt injection) и предотвращения скрытой утечки данных.

По сути, компания признает, что по мере того, как ИИ-системы получают доступ к интернету и сторонним приложениям, риски эксплуатации этих связей возрастают. Новые инструменты дают администраторам и пользователям возможность сознательно ограничивать функциональность моделей ради гарантированной безопасности данных.

Долгое время основной угрозой для языковых моделей считалась генерация токсичного контента. Однако с появлением агентских систем, способных выполнять действия в интернете и подключаться к корпоративным базам данных, вектор атак изменился. Промпт-инъекции — это метод, при котором злоумышленник скрывает инструкции внутри текста (например, на веб-странице или в документе), заставляя ИИ выполнить вредоносное действие, например, отправить конфиденциальные данные на сервер хакера.

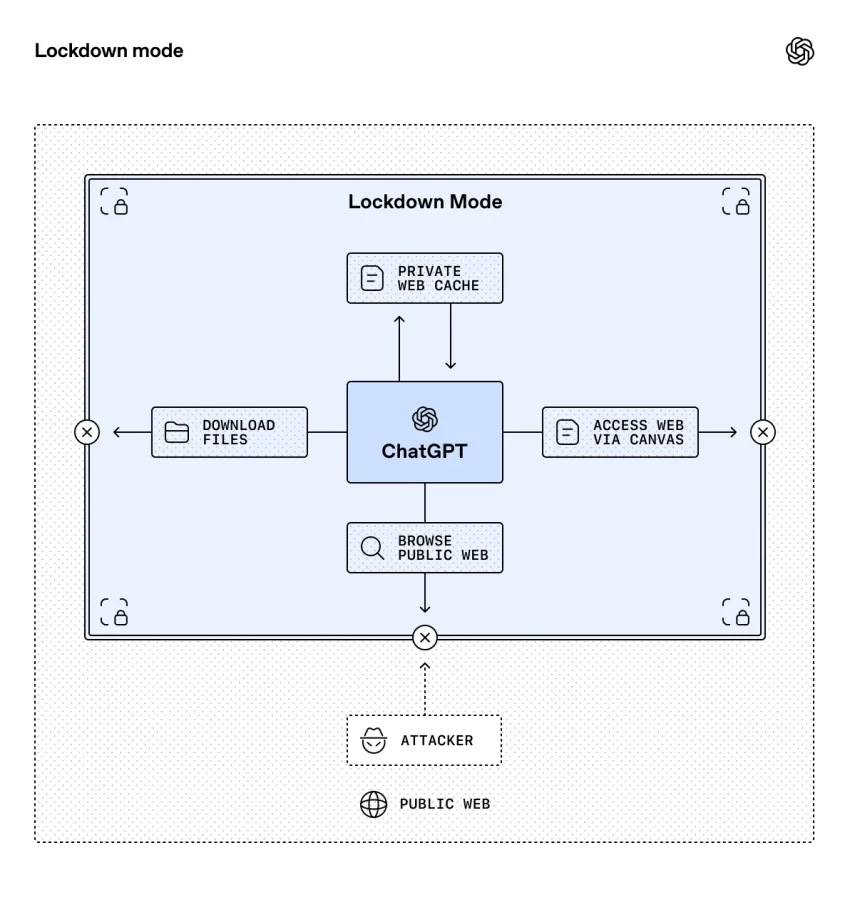

Diagram titled “Lockdown mode” showing ChatGPT inside a secured boundary with connections to a Private Web Cache, Download Files, Access Web via Canvas, and Browse Public Web. An external “Attacker” and the Public Web are depicted outside the boundary, with blocked entry points indicating restricted access in lockdown mode.

Ранее защита строилась на фильтрации входящих и исходящих данных, но эти методы не давали стопроцентной гарантии. Введение жестких детерминированных ограничений (Lockdown Mode) сигнализирует о переходе индустрии к более зрелому подходу: физическому ограничению возможностей модели в критически важных сценариях.

Lockdown Mode — это опциональная настройка для пользователей с высокими требованиями к безопасности, таких как топ-менеджеры или сотрудники служб безопасности. Главная особенность режима — детерминизм. Это означает, что правила блокировки работают жестко и предсказуемо, не полагаясь на вероятностные суждения самой нейросети.

Ключевые ограничения режима:

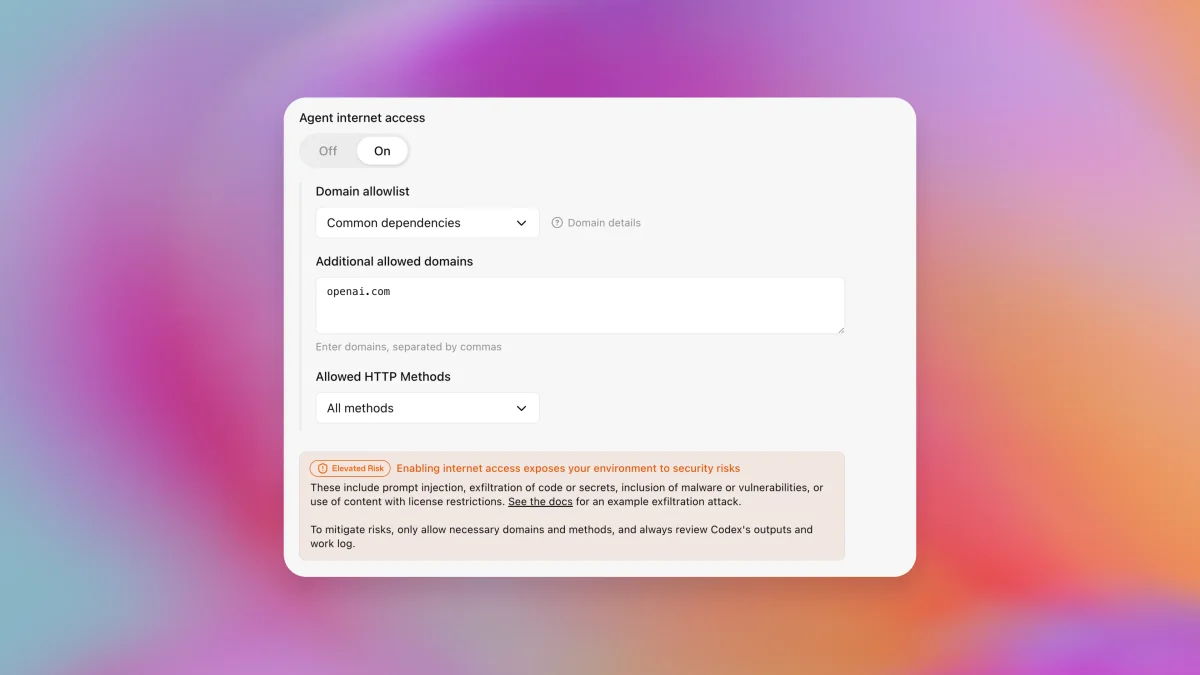

Второе нововведение — маркировка «Повышенный риск» (Elevated Risk). Это унифицированный интерфейсный элемент, который будет появляться в ChatGPT, ChatGPT Atlas и Codex. Если функция требует доступа к сети или выполнения кода, пользователь увидит предупреждение. Это перекладывает часть ответственности на пользователя, заставляя его принимать осознанное решение о включении потенциально опасных возможностей.

Внедрение этих функций демонстрирует важный сдвиг в философии разработки ИИ-продуктов. Раньше фокус был на максимальной полезности и универсальности. Теперь мы видим движение в сторону «безопасности по дизайну» (security by design), даже если это идет в ущерб удобству.

Для корпоративного сектора это критически важно. Многие компании опасались внедрять ИИ-агентов именно из-за риска скрытой эксфильтрации данных (data exfiltration). Режим изоляции, который физически запрещает модели отправлять данные во внешний мир через веб-запросы, может стать тем аргументом, который убедит консервативные службы безопасности разрешить использование ИИ.

Интересно, что OpenAI планирует открыть доступ к Lockdown Mode для обычных потребителей в ближайшие месяцы, что говорит о демократизации инструментов кибербезопасности.

Скорее всего, мы увидим разделение ИИ-систем на два класса: «открытые» агенты с полным доступом к сети для бытовых задач и «изолированные» агенты для работы с чувствительными данными. Маркировка рисков станет отраслевым стандартом, подобно предупреждениям безопасности в браузерах.

OpenAI также заявляет, что будет снимать метки «Повышенный риск» по мере совершенствования защитных механизмов. Это создает динамическую среду, где функции будут проходить своеобразный карантин перед тем, как стать общедоступными без предупреждений. В долгосрочной перспективе это повысит доверие к технологии, так как пользователи будут четко понимать границы возможностей и рисков своих цифровых помощников.

OpenAI переходит от вероятностной защиты к жестким детерминированным ограничениям для критически важных данных, жертвуя функциональностью ради безопасности.

Признание того, что программные фильтры ИИ не могут полностью защитить от атак, вынуждает разработчиков возвращаться к классическим методам сетевой изоляции (песочницам).

Settings panel for “Agent internet access” with the toggle set to On, showing options for a domain allowlist, additional allowed domains (including openai.com), allowed HTTP methods, and a highlighted warning noting elevated security risks when enabling internet access.