Индустрия искусственного интеллекта переживает важный переходный этап: от использования моделей, которые просто генерируют текст, к созданию агентов, способных выполнять сложные многошаговые задачи. Чтобы модель стала агентом, ей нужен доступ к инструментам. OpenAI анонсировала масштабное обновление Responses API, которое дает моделям полноценную вычислительную среду.

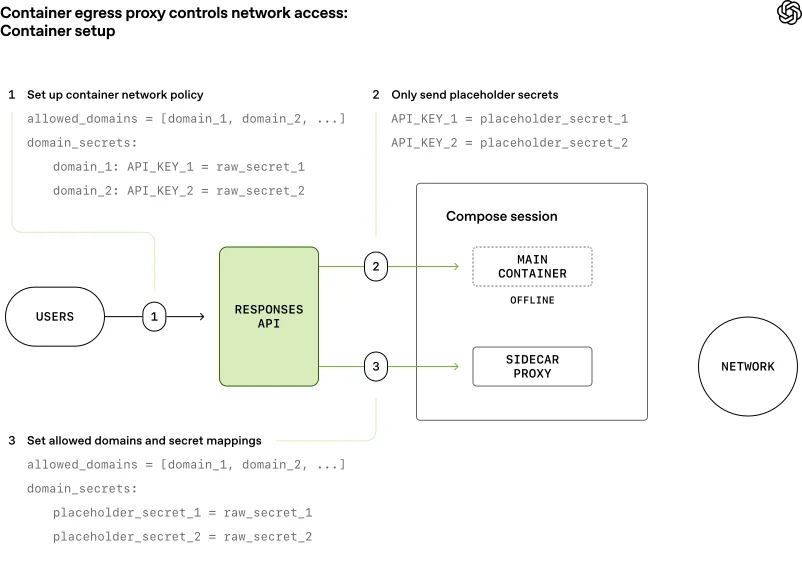

До сих пор разработчикам, создающим автономных агентов, приходилось самостоятельно решать множество инфраструктурных проблем. Где хранить промежуточные файлы? Как избежать копирования огромных таблиц в системный промпт (prompt)? Как обеспечить агенту доступ в интернет, не создавая уязвимостей в безопасности? Теперь OpenAI берет эти задачи на себя, предоставляя изолированное рабочее пространство (container workspace) прямо «из коробки».

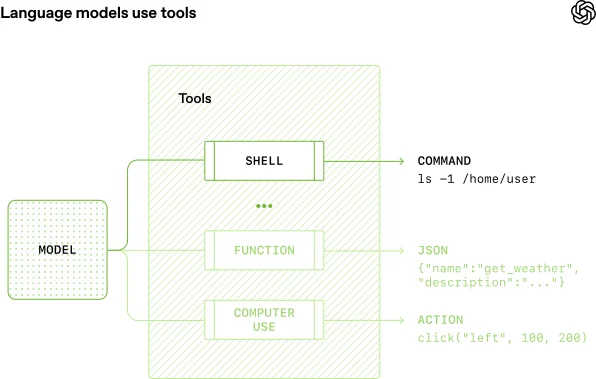

The shell tool is "just another tool" with diagram

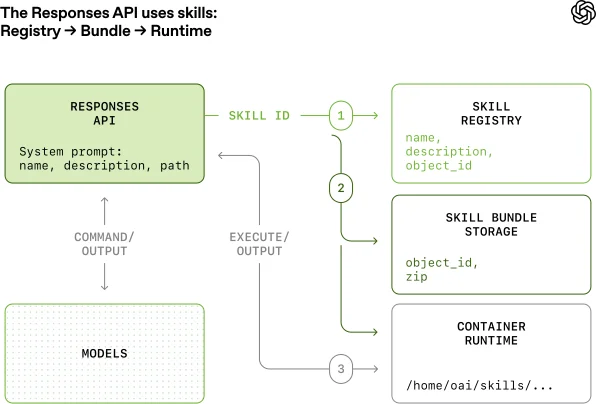

В основе новой системы лежит инструмент командной оболочки (shell tool). В отличие от предыдущего интерпретатора кода, который поддерживал только Python, новая оболочка позволяет моделям (начиная с GPT-5.2) использовать привычные Unix-утилиты, такие как grep, curl и awk. Более того, агент может запускать программы на Go, Java или поднимать серверы на NodeJS. Модель лишь предлагает команды, а платформа безопасно выполняет их в изолированном контейнере.

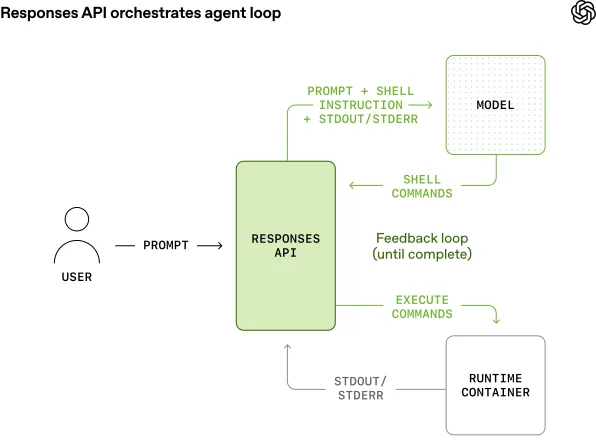

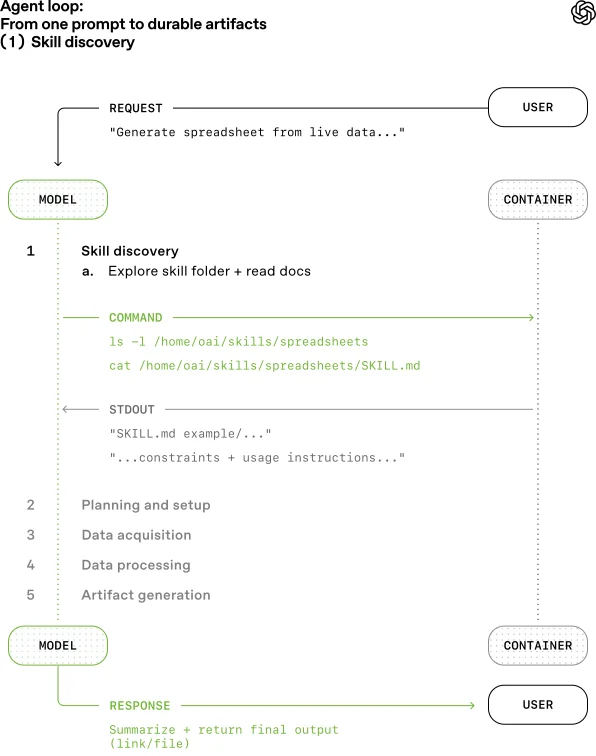

Ключевой элемент обновления — это оркестрация цикла выполнения. Responses API автоматически управляет процессом: принимает команды от модели, отправляет их в среду выполнения, транслирует результаты обратно и запрашивает следующий шаг. Платформа поддерживает параллельное выполнение команд в разных сессиях, что значительно ускоряет работу агента при поиске файлов или сборе данных.

Чтобы модель не «захлебнулась» в потоке логов терминала, введено ограничение вывода. Если результат выполнения команды слишком длинный, API возвращает только начало и конец текста, помечая пропущенную часть. Это экономит контекстное окно без потери критически важной информации.

Agent loop diagram: Responses API orchestrates model and shell execution in container

Для по-настоящему долгих задач, которые неизбежно переполняют память модели, OpenAI внедрила нативную систему сжатия (compaction). Модели обучены анализировать историю беседы и создавать зашифрованное, эффективное с точки зрения токенов представление предыдущих состояний. Это позволяет агенту сохранять логику работы на протяжении сотен шагов. Интересно, что эта система разрабатывалась при участии модели Codex, которая помогала инженерам отлаживать механизм сжатия, анализируя собственные ошибки.

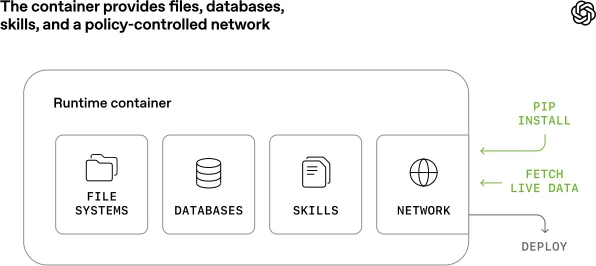

Помимо командной строки, контейнер предоставляет агенту структурированный контекст. Вместо того чтобы загружать в промпт весь документ, разработчики могут поместить данные в файловую систему или базу данных SQLite внутри контейнера. Модель сама решит, какие строки таблицы ей нужно запросить с помощью SQL-команд для ответа на вопрос пользователя.

Это обновление фундаментально меняет подход к разработке ИИ-приложений. Смещение фокуса с написания сложных инструкций (prompt engineering) на проектирование инфраструктуры данных внутри контейнеров делает агентов более надежными, быстрыми и дешевыми в эксплуатации. Мы наблюдаем, как языковые модели превращаются в полноценные операционные системы для решения прикладных задач.